- エヌビディア一強体制の終焉──Google・Amazon・Metaが仕掛ける「GPU包囲網」とAI半導体の勢力図激変

- エヌビディアの「異常な利益率」がビッグテックを怒らせた

- Google──TPU第8世代と4社チップサプライチェーン

- Amazon──Trainium2/3で「最安のAI計算」を武器に

- Meta──MTIA 4チップ一挙発表、Broadcomと共同で脱NVIDIA

- Microsoft──Maia 200で3nm世代に突入

- Anthropic──AmazonとGoogleの「両方に縛られる」特異な構造

- OpenAI──Microsoft独占は解消されたが影響力は残る

- 「学習から推論へ」──エヌビディアの優位性が薄れる構造転換

- Broadcom──「エヌビディアの対抗馬」の黒幕

- エヌビディアの反撃──Groq買収と推論特化戦略

- まとめ──一強は終わり、「多極化」の時代へ

エヌビディア一強体制の終焉──Google・Amazon・Metaが仕掛ける「GPU包囲網」とAI半導体の勢力図激変

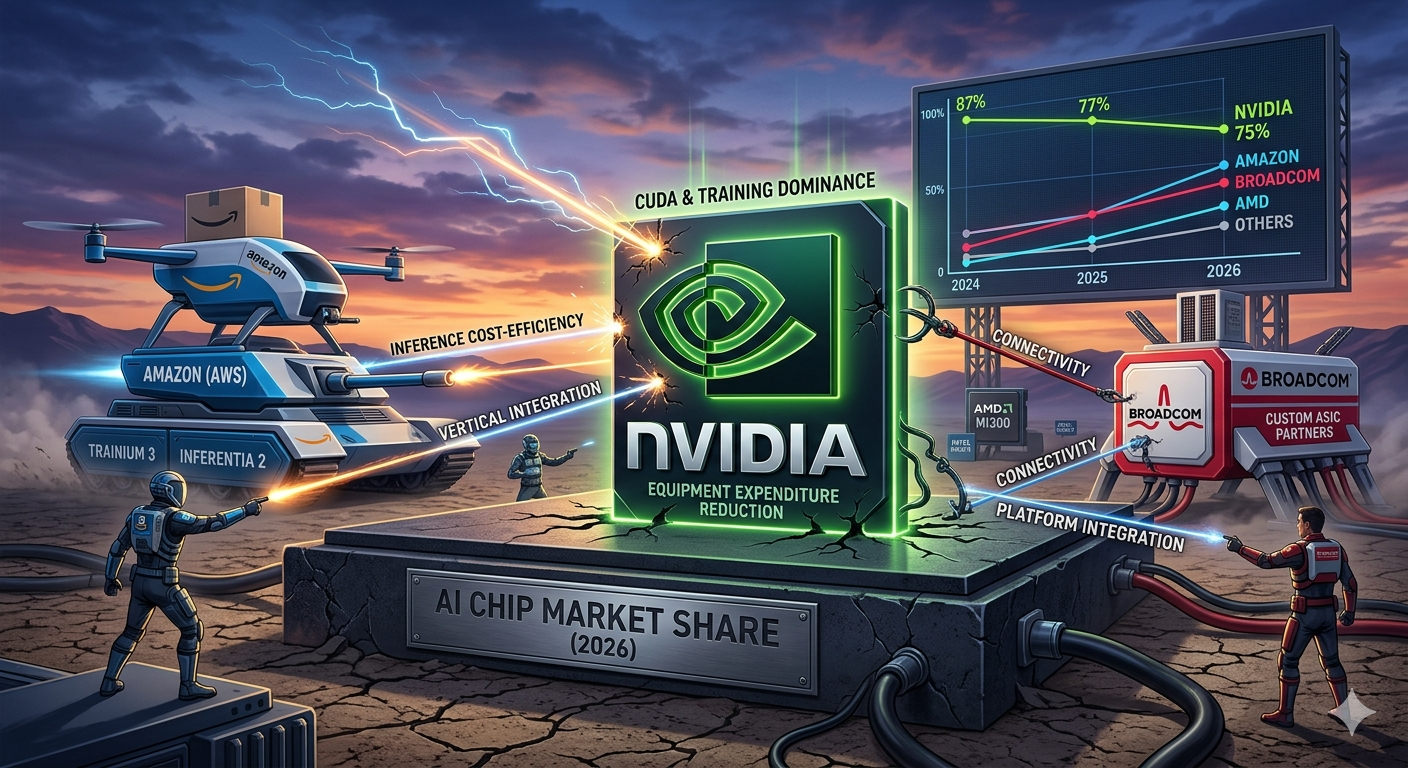

AI半導体市場の王者エヌビディア(NVIDIA)の一強体制に、かつてない逆風が吹いている。Google、Amazon、Meta、Microsoft──AI投資の最大の顧客であるビッグテック各社が、次々と自社チップの開発・外販に乗り出し、エヌビディアのGPUへの依存を減らそうと躍起だ。

さらに、AIの計算需要が「学習(トレーニング)」から「推論(インファレンス)」へとシフトする中、エヌビディアのGPUが持つ圧倒的優位性は推論の世界では薄まりつつある。2026年、AI半導体の勢力図は根本から変わり始めている。

エヌビディアの「異常な利益率」がビッグテックを怒らせた

エヌビディアの強さを象徴する数字がある。データセンター部門の粗利益率75%、営業利益率69%だ。

| 指標 | データセンター部門 | ゲーミング部門 |

|---|---|---|

| Q4 FY2026 売上 | 325億ドル | 約80億ドル(年間) |

| 粗利益率 | 約75% | 約35% |

| 営業利益率 | 約69% | 約40% |

FY2026通期では、売上高2,159億ドル(前年比65%増)、粗利益率71.1%を記録。つまり、ビッグテックがAIインフラに注ぎ込む巨額投資のうち、実に7割以上がエヌビディアの利益として吸い上げられている計算だ。

Meta単体でAIインフラに最大1,350億ドルを投資する2026年、GoogleがCapExに1,800〜1,900億ドルを計上する2026年──その大半がエヌビディアのGPUに流れるとすれば、ビッグテックが「利益率を下げさせたい」と考えるのは当然だ。

Google──TPU第8世代と4社チップサプライチェーン

最も攻勢をかけているのがGoogleだ。

TPU v8:学習と推論の二刀流

2026年4月、Googleは第8世代TPUとして「TPU 8t」(学習特化)と「TPU 8i」(推論特化)の2チップを発表した。AIエージェントの複雑な反復処理に最適化され、前世代から電力効率と性能が大幅に向上。

Googleの総TPU出荷数は2026年に430万ユニット、2028年には3,500万ユニット超に拡大する見通しだ。

4社サプライチェーンでの外販体制

さらに注目すべきは、GoogleがBroadcom、MediaTek、Marvellの3社と推論チップのサプライチェーンを構築し、Google Cloud経由で外販する体制を整えていることだ。これはもはや「自社用チップ」の域を超え、エヌビディアの市場を直接奪いに行く動きだ。

Q1 2026のGoogle Cloud決算では、クラウド売上が200億ドル(+63%)、バックログが4,620億ドルに倍増。この急成長の背景には、TPU搭載のクラウドインスタンスの需要拡大がある。

Amazon──Trainium2/3で「最安のAI計算」を武器に

AWSも自社チップで急速にエヌビディア依存を減らしている。

Trainiumの進化

- Trainium2:2024年12月にGA(一般提供)開始。H100ベースのP5eインスタンスに対し30〜40%の価格性能比優位

- Trainium3:FP8で2.52 PFLOPS、HBM3e 144GB搭載。OpenAIとAnthropicが学習・推論に採用確定

- Trainium4以降:Anthropicとの10年・1,000億ドル超の大型契約で、5GWのコンピュート容量を確保

Amazonの戦略は明快だ。自社チップで「最もコスト効率の良いAI計算環境」を提供し、エヌビディアのGPUを選ぶ理由を消すこと。すでにAnthropicはTrainiumの大口顧客であり、AWSのカスタムチップエコシステムに深く組み込まれている。

Meta──MTIA 4チップ一挙発表、Broadcomと共同で脱NVIDIA

Metaの動きは最も激しい。2026年3月、MTIA 300・400・450・500の4チップを一挙に発表。約6ヶ月ごとに新チップを投入するペースで、全てBroadcomとの共同開発、TSMC製造、RISC-Vアーキテクチャを採用している。

なぜRISC-Vか

MetaがArmではなくオープンソースのRISC-Vを選んだのは、ライセンス依存を避けるためだ。GPUのエヌビディア依存、CPUのArm依存──いずれからも脱却し、自社でチップ設計の主導権を握る意図が明確だ。

MTIA 300→500でHBM帯域幅は4.5倍、計算性能(FLOPS)は25倍に向上する計画。Metaは過去1年だけでBroadcomに23億ドルをチップ設計費として支払っており、AI投資1,350億ドルの中核にカスタムシリコンを据えている。

Microsoft──Maia 200で3nm世代に突入

Microsoftも自社チップ「Maia 200」をTSMC 3nmプロセスで開発。FP4性能ではAmazonのTrainium3の3倍を主張しており、Azure上でのAI推論に特化した設計だ。

MicrosoftはOpenAIとの独占契約を解消したばかりだが(後述)、自社のAzureプラットフォーム上でMaia 200を活用することで、エヌビディアへの依存とOpenAIへの依存を同時に下げる二重の戦略を進めている。

Anthropic──AmazonとGoogleの「両方に縛られる」特異な構造

AIの牽引役であるAnthropicの立場は、実は極めて複雑だ。

巨額投資の代償

| 投資元 | 金額 | 条件 |

|---|---|---|

| 最大400億ドル(確定100億+条件付き300億) | 評価額3,500億ドル、TPU使用 | |

| Amazon | 累計最大250億ドル+ | 10年・1,000億ドル超のAWSインフラ契約 |

Anthropicは「Google TPU、Amazon Trainium、NVIDIA GPUの3つのチップを分散利用する」と説明しているが、実態はGoogleとAmazonのカスタムチップエコシステムに深く組み込まれている。

Google向けにはTPU 100万チップ規模のアクセスを確保し、Amazon向けにはTrainium2〜4世代にわたる長期購入契約を結んでいる。Broadcomとの提携で2027年から3.5GW規模のTPUコンピュート容量も確保した。

つまり、Anthropicは世界最先端のAIモデルを開発しながら、そのインフラはGoogleとAmazonのカスタムチップに依存する構造に陥っている。これはエヌビディアのGPUに依存しないという点では「脱NVIDIA」だが、代わりにビッグテック2社に縛られるという新たな依存を生んでいる。

OpenAI──Microsoft独占は解消されたが影響力は残る

2026年4月27日、OpenAIとMicrosoftは独占契約を正式に解消した。OpenAIは今後、AWSやGoogle Cloudでもサービスを提供できるようになった。

しかし、Microsoftの影響力は消えない

- ライセンス:MicrosoftはOpenAIのIPに対する非独占ライセンスを2032年まで保持

- レベニューシェア:OpenAIがMicrosoftに支払うレベニューシェアは2030年まで継続(上限付き)

- 取締役会:Microsoftは取締役会のオブザーバー席を維持

- インフラ:OpenAIの既存インフラの大部分はAzure上で稼働中

独占契約は解消されたが、収益構造、IP、インフラの3つでMicrosoftの影響力は残存している。OpenAIが自社チップ「Titan」をBroadcomと共同開発中(TSMC 3nm、2026年末配備予定)なのも、この依存を断ち切るための動きだ。

「学習から推論へ」──エヌビディアの優位性が薄れる構造転換

AI半導体市場で起きている最も重要な変化は、計算需要の重心が「学習」から「推論」へ移行していることだ。

推論が主役になる数字

- 2025年:AI計算支出の50%が推論

- 2026年:推論が3分の2に拡大見込み

- 推論は全計算ライフサイクルの80〜90%のコストを占める

なぜ推論でエヌビディアの優位が薄れるのか

エヌビディアのGPUは学習(大量のデータを並列処理して巨大なモデルを訓練する)において圧倒的な優位を持つ。CUDAエコシステム、PyTorchとの統合、ツールの成熟度で、学習分野のシェアは90%以上を維持している。

しかし推論は事情が異なる。推論は「訓練済みモデルをユーザーのクエリに応じて実行する」処理であり、学習のような汎用的な並列計算力よりも、低レイテンシ・高電力効率・特定モデルへの最適化が重要になる。ここでは特化型ASIC(TPU、Trainium、MTIA等)がGPUに対して構造的な優位を持つ。

市場シェアの見通し

| 分野 | エヌビディアの現在シェア | 2028年予測 |

|---|---|---|

| 学習(トレーニング) | 90%以上 | 85%以上(CUDA優位維持) |

| 推論(インファレンス) | 80〜85% | 20〜30%に低下 |

カスタムASICの成長率は2026年に前年比45%増、GPUの出荷成長率16%の約3倍のペースだ。推論市場ではTPUやASICが70〜75%を奪取するとの予測もある。

Broadcom──「エヌビディアの対抗馬」の黒幕

ビッグテック各社のカスタムチップ開発の裏には、ほぼ必ずBroadcomがいる。

- Google:TPUの設計パートナー

- Meta:MTIAの共同開発、年間23億ドルのチップ設計費

- OpenAI:Titanチップの共同開発(100億ドル超の契約)

- Anthropic:Google-Broadcom連合で3.5GWのTPU容量

カスタムASIC市場の約80%をBroadcomが支配しており、エヌビディアの一強が崩れた先に立つのは、実はBroadcomかもしれない。ASIC市場は2033年に1,180億ドルに達する見通しだ。

エヌビディアの反撃──Groq買収と推論特化戦略

エヌビディアもこの状況を座視してはいない。

2025年12月、推論特化チップ企業Groqを200億ドルで買収。Groqの「LPU(Language Processing Unit)」は低レイテンシ推論に特化しており、GPUの弱点を補完する。GTC 2026では推論分野への大幅なフォーカスシフトを打ち出した。

しかし、これは裏を返せばエヌビディア自身がGPUだけでは推論市場を守れないと認めたことでもある。

まとめ──一強は終わり、「多極化」の時代へ

2026年現在、エヌビディアは依然としてAI半導体の王者だ。FY2026の売上2,159億ドル、データセンター売上の圧倒的な規模は揺るがない。

しかし、以下の構造変化は不可逆だ。

- ビッグテック全社がカスタムチップを開発:Google TPU、Amazon Trainium、Meta MTIA、Microsoft Maia、OpenAI Titan

- 推論へのシフト:計算需要の2/3が推論になり、ASIC優位の領域が拡大

- 利益率への圧力:カスタムチップ成長率45% vs GPU成長率16%の差が拡大

- AI企業のチップ依存先が分散:Anthropicはgoogle+Amazon、OpenAIはMicrosoft+Broadcom

エヌビディアの一強体制は「終わる」のではなく、「多極化」していく。その中で投資家が問うべきは、「エヌビディアが成長するか否か」ではなく、「成長のどれだけを自社で保持できるか」──つまり利益率の行方だ。粗利益率75%の時代は、もう長くは続かないかもしれない。

※本記事は2026年4月30日時点の情報に基づいています。投資判断はご自身の責任で行ってください。

参考情報

- CNBC:Google unveils chips for AI training and inference in latest shot at Nvidia

- Nerd Level Tech:The Custom AI Chip Race in 2026

- InvestorPlace:The Rise of Custom AI Chips Is Breaking Nvidia’s Grip

- TechTicker:AI Inference vs Training Chips – The Critical $200B Split

- CNBC:Amazon to invest up to another $25 billion in Anthropic

- TechCrunch:Google to invest up to $40B in Anthropic

- CNBC:OpenAI shakes up partnership with Microsoft

- Meta:Expanding Meta’s Custom Silicon to Power Our AI Workloads

- NVIDIA:FY2026 Financial Results

コメント